El eurodiputado Axel Voss ha instado a la Comisión Europea a revisar con urgencia si la legislación actual sobre derechos de autor en la UE es adecuada para abordar el uso de contenidos protegidos en el entrenamiento de modelos de inteligencia artificial generativa.

¿Qué está en juego?

La polémica gira en torno al uso masivo de obras protegidas por derechos de autor por parte de empresas de IA para entrenar modelos generativos, como los utilizados para crear contenidos similares a los creados por humanos. Este proceso ha generado preocupación en las industrias creativas, especialmente la musical, donde se teme una explotación no autorizada de obras originales.

¿Qué es la excepción de minería de texto y datos (TDM) en la UE?

La legislación actual de la Unión Europea, concretamente el Artículo 4 de la Directiva sobre Derechos de Autor de 2019, incluye una excepción llamada “minería de texto y datos” (TDM por sus siglas en inglés). Esta cláusula permite a determinadas entidades extraer patrones y correlaciones de grandes volúmenes de datos sin necesidad de pedir permiso a los titulares de derechos, salvo que estos se hayan opuesto expresamente.

Sin embargo, muchas empresas tecnológicas están utilizando esta excepción para justificar el uso de obras protegidas en el entrenamiento de sus modelos de IA generativa. Pero, ¿realmente se aplica esta excepción a la IA?

Un nuevo informe jurídico lo deja claro: la TDM no cubre la IA generativa

El informe encargado por la comisión de asuntos jurídicos del Parlamento Europeo, elaborado por la profesora de derecho española Nicola Lucchi, sostiene que el artículo 4 no fue diseñado para cubrir el entrenamiento de modelos de IA generativa.

Lucchi argumenta que la excepción TDM fue pensada para fines científicos, como el análisis de datos o la identificación de patrones, y no para absorber y recombinar aspectos creativos o estilísticos de obras protegidas, algo que sí hacen los modelos de IA generativa.

Según la experta, los sistemas de IA no se limitan a identificar patrones; “absorben, codifican y recombinan características estilísticas, estructurales y expresivas” de los contenidos. Esto supone una reproducción de obras que, según la legislación vigente, requiere permiso de los titulares de derechos.

La comparación con los humanos no se sostiene legalmente

Uno de los argumentos más repetidos por las tecnológicas es que los modelos de IA entrenan igual que los seres humanos aprenden: consumiendo contenidos y produciendo nuevas obras inspiradas en ellos.

Sin embargo, Lucchi desmonta esta comparación: mientras los humanos entienden, interpretan y transforman ideas, la IA simplemente procesa patrones estadísticos. “La IA actúa sin comprensión”, afirma, citando al filósofo Luciano Floridi. Y ese matiz tiene implicaciones legales clave: copiar fragmentos de obras protegidas para entrenar modelos se considera reproducción, aunque el resultado final parezca distinto.

El Parlamento Europeo estudia crear una excepción específica para la IA

Durante la reunión parlamentaria, Axel Voss propuso revisar el artículo 4 o incluso crear una excepción específica para la IA, diseñada para equilibrar los intereses de los creadores con los de las empresas tecnológicas. Su objetivo es evitar una aplicación forzada y descontextualizada de una normativa que no fue pensada para los desafíos actuales.

El sector musical celebra el informe

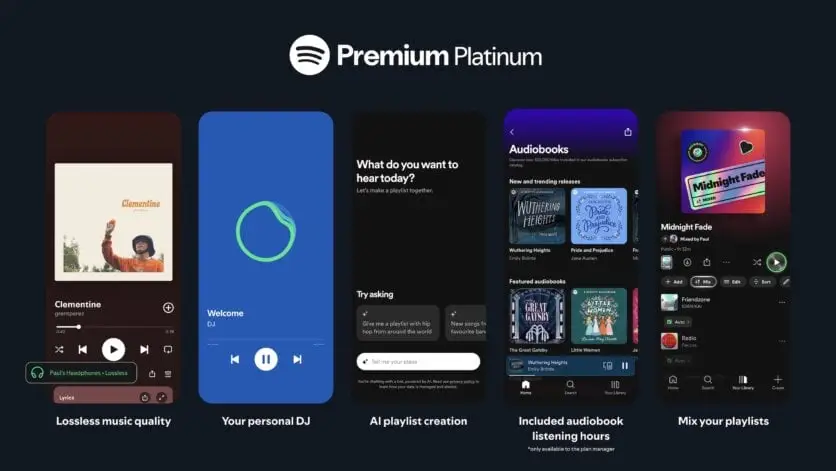

La comunidad musical europea —al igual que otras industrias culturales— apoya firmemente la idea de que no debe existir ninguna excepción para entrenar IA generativa sin permiso. Si se confirma que la TDM no es aplicable, las empresas de IA tendrán que negociar licencias y compensaciones con los titulares de derechos, lo que supone una victoria para artistas, autores, sellos y editoriales.

Esta postura se alinea con lo dictaminado este año por la Oficina de Derechos de Autor de Estados Unidos, que también concluyó que el principio de “uso justo” (fair use) no se puede aplicar automáticamente al entrenamiento de IA.